Sevensense Robotics AG

Galerie

Beschreibung

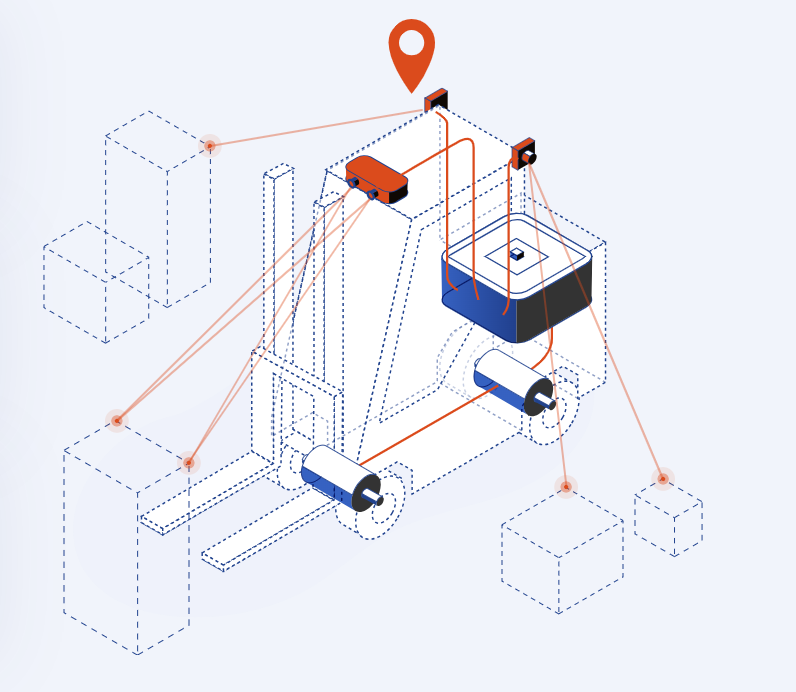

Bei Sevensense Robotics treiben wir die Grenzen der mobilen Robotik voran. Unsere Mission ist es, die Augen und das Gehirn für die Roboter der Zukunft zu entwickeln! Mit unserer Technologie können mobile Maschinen autonom in dynamischen und überfüllten Umgebungen navigieren. Dadurch ermöglichen wir neue robotergestützte Anwendungen an Orten wie Flughäfen, Supermärkten, Lagerhäusern.

Sevensense Robeotics beschleunigt die technologische Innovation in der Servicerobotikbranche, indem es Robotern ermöglicht, sicher und autonom in dynamischen Räumen zu navigieren, die sie mit Menschen teilen, sowohl im Innen- als auch im Aussenbereich. Unser Ziel ist es, die Integration und den Einsatz mobiler Roboter durch unsere Lösung zu vereinfachen, die bei minimaler Installationszeit auf jede Art von mobilen Bodengeräten, von Gabelstaplern bis hin zu Liefer- und Reinigungsmaschinen, angewendet werden kann.

Die Kerntechnologie von Sevensense Robotics basiert auf Computer Vision und KI-Techniken, die aus über 15 Jahren Forschung an der Eidgenössischen Technischen Hochschule (ETH) Zürich hervorgegangen sind. Wir entwickeln, liefern und integrieren sowohl Software als auch Hardware und bieten eine Komplettlösung für alle, die ihre Maschinen autonom bewegen wollen. Wir glauben nämlich fest an das Potenzial der kamerabasierten Navigation, die mobile Roboter auf die nächste Stufe heben wird.

Unser robustes Lokalisierungssystem und unsere intelligenten Navigationsalgorithmen basieren auf fortschrittlicher Sensorik und Sensorfusion und bieten selbst in überfüllten und sich schnell verändernden Umgebungen, in denen andere Lösungen versagen, eine unübertroffene Zuverlässigkeit und Robustheit.

Unser Sortiment besteht aus folgenden Produkten:

Alphasense Position

- Vollständige 3D Zuordnung und Posenausgabe: Ermöglicht den Fahrzeugen die Navigation auf unebenem Gelände, über Rampen und auf mehreren Etagen

- Unterstützung mehrerer Kamera: Unterstützt bis zu 8 Kamerastreams, die in Echtzeit verarbeitet werden

- Kartenfreigabe: Gibt Karten automatisch für eine Fahrzeugflotte frei, um die Zusammenarbeit zu koordinieren

- Hochwertige Schätzung: Auf 1cm genau

- Erweitere Kalibrierung: Enthält modernste Algorithmen zur völlig autonomen Kalibrierung des Produktionssystems

- KI: Lernt kontinuierlich, wie sich die Umgebung verändert, und aktualisiert die Karte mithilfe natürlicher Merkmale

Alphasense Position

- Mehrere Navigationsmodi: Kann sowohl die herkömmliche Verfolgung virtueller Pfade als auch die Vermeidung von Hindernissen und die flexibelste freie Navigation durchführen

- Automatische Sensorkalibrierung: Alle Sensoren werden im Werk automatisch kalibriert, wodurch eine manuelle Abstimmung während des Einsatzes entfällt

- Edge-KI: Alle Informationen befinden sich im Fahrzeug, sodass Probleme im Zusammenhang mit dem Verlust der Konnektivität ausgeschlossen sind

- Visueller 3D Slam: Unsere erstklassigen SLAM-Algorithmen sorgen für eine robuste Roboterpositionierung

- 3D-Sensorfusion: Die flexible Datenfusion vieler Sensormodalitäten ermöglicht die Erkennung jeglicher Art von Hindernissen in 3D

- Layout- und FMS-Kompatibilität: Unterstützt den VDA5050-Standard, um die Kompatibilität mit Layout-Design-Tools und FMS zu maximieren und Interoperabilität zu gewährleisten

Core Research

Das ist ein hochmoderner visueller Inertialsensor, mit dem visuelle KI-Anwendungen erforscht werden können. Es besteht aus fünf hochempfindlichen Kameras sowie einer synchronisierten IMU und verfügt über folgende technischen Attribute:

- Ein starrer Rahmen mit 5 Global-Shutter-Kameras, die mit modernsten Bildsensoren ausgestattet sind

- Eine Hochleistungs-IMU

- Präzise Zeitsynchronisation und Zeitstempelung von Kamera- und IMU-Daten

- PTP-Zeitsynchronisierung mit einem Host-PC für die nahtlose Zusammenarbeit mit zusätzlichen Sensoren

- Gigabit-Ethernet-Schnittstelle